OpenAI запустила GPT-4 — следующее поколение нейросети в основе ChatGPT. Что она умеет

14 марта компания OpenAI представила ИИ-модель GPT-4 — и сразу объявила о ее внедрении в приложения и сервисы.

Языковая модель известна в первую очередь по ChatGPT — прорывному ИИ-боту, с которым можно общаться, просить написать тексты любой сложности и искать информацию. GPT-4 намного мощнее нейросети в основе ChatGPT, которая работала на предыдущей версии, GPT-3,5. Новое поколение не только запоминает контекст и подстраивается под запросы пользователя, но и умеет обрабатывать изображения, а также «демонстрирует уровень человека» в ряде академических и профессиональных тестов.

Рассказываю, чем интересна GPT-4, которую уже начали внедрять в привычные сервисы вроде поисковика Microsoft Bing и приложения Duolingo.

Чем GPT-4 лучше предыдущей модели

Обрабатывает не только текст, но и изображения. Это самое заметное отличие от привычного ChatGPT. GPT-4 — мультимодальная модель, она научилась считывать изображения, понимать их контекст и работать с запросами на основе картинок. Можно отправить нейросети фото, график, скриншот или мем, а потом уже строить от этого текстовый запрос. Например, сфотографировать содержимое холодильника и предложить составить блюдо из продуктов в наличии.

Отвечает GPT-4 все еще только в текстовом виде, нельзя попросить нарисовать что-то. Также возможность обработки картинок пока есть только для ограниченного числа бета-тестеров и компаний. OpenAI обещает более широкое внедрение функции позже.

Обработка изображений в GPT-4 — пример OpenAI

Пользователь: что забавного в этой картинке? Опиши кадр за кадром.

GPT-4: на картинке — три панели с упаковкой адаптера Lightning.

Первая панель: смартфон с воткнутым VGA-адаптером (большой синий 15-контактный штекер, который обычно используют для компьютерных мониторов).

Вторая панель: упаковка от кабеля Lightning с изображением VGA-адаптера.

Третья панель: крупный план VGA-адаптера с небольшим штекером Lightning (используется для зарядки Айфонов и других устройств Apple) на конце.

Юмор — в абсурдности подключения большого и устаревшего VGA-адаптера к маленькому и современному порту для зарядки смартфона.

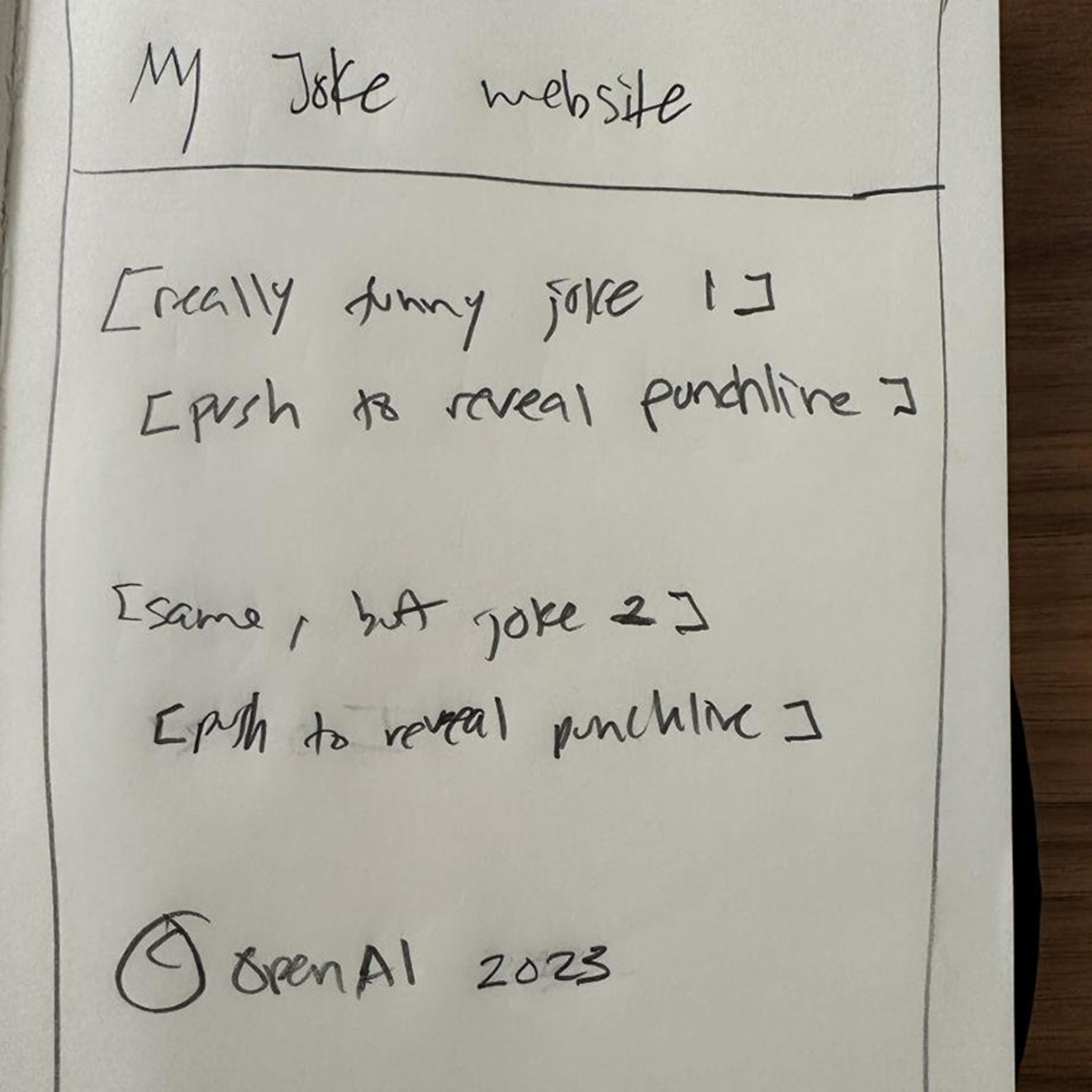

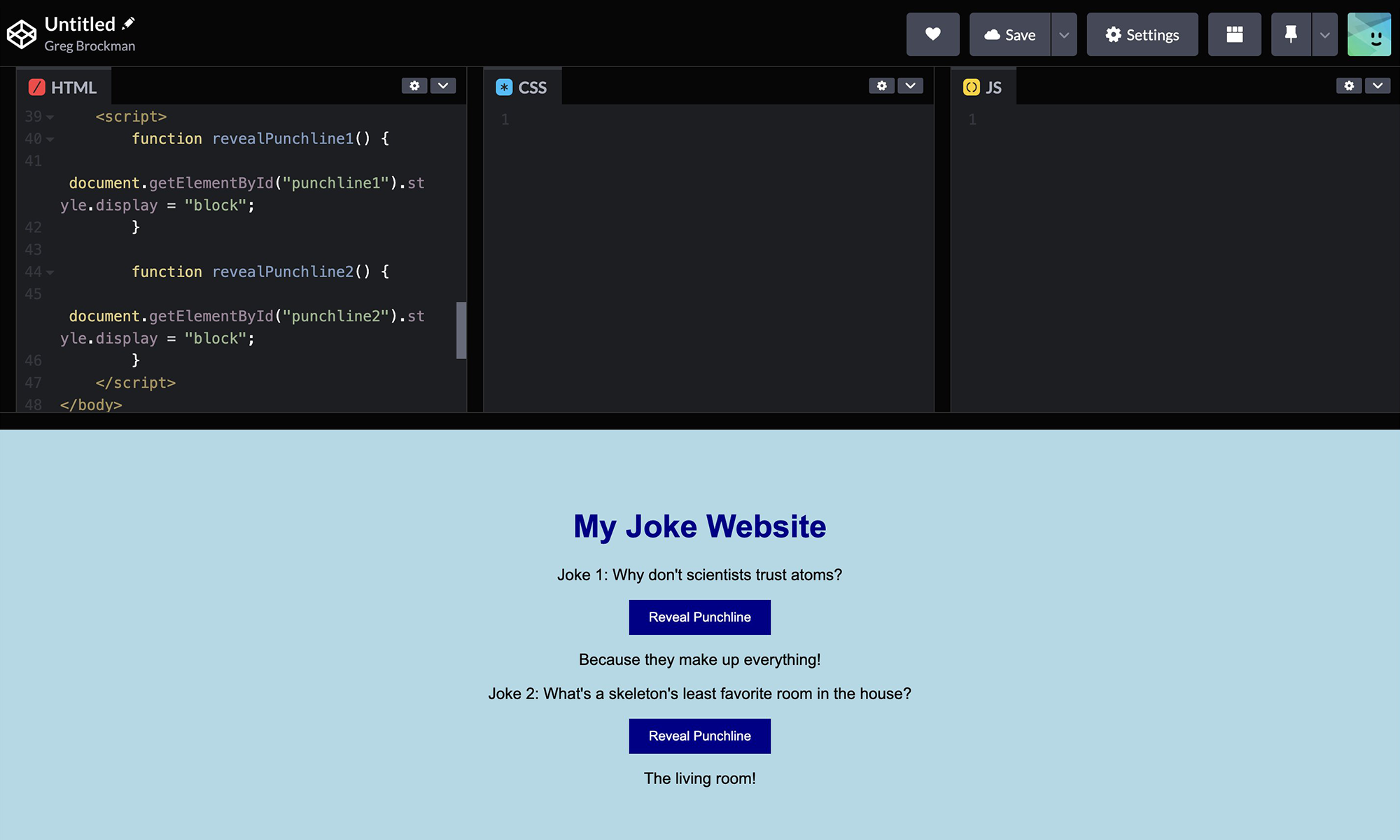

У работы с картинками есть и другие сценарии. Во время трансляции OpenAI выступил сооснователь компании Грег Брокман. Он сфотографировал лист своего блокнота с наброском макета сайта: название My Joke Website и страница с двумя «действительно смешными шутками», самая смешная часть которых должна показываться по нажатию кнопки.

Брокман загрузил фото в GPT-4 и попросил нейросеть: «Напиши код HTML/JS, чтобы превратить этот макет в красочный веб-сайт, где шутки заменены двумя настоящими шутками». Та написала код для простого сайта с учетом пожеланий.

Расширяет возможности работы с текстом. В OpenAI предупреждают: в бытовом общении и простых задачах разница между GPT-3,5 и GPT-4 может быть едва заметной. Однако разрыв между версиями становится очевидным по достижении определенного порога сложности задачи. GPT-4 на фоне предшественника более надежна, креативна и способна работать с «тонкими сценариями».

GPT-4 гораздо гибче подстраивается под пользователя, когда тот просит нейросеть отыгрывать определенную роль и придерживаться конкретной стилистики ответов. Также языковая модель лучше учитывает контекст, который ей дает человек. Для этого лимит на сообщение с текстовым запросом увеличили до 25 тысяч слов. Это значит, что GPT-4 можно отправлять целые документы и большие отрывки произведений.

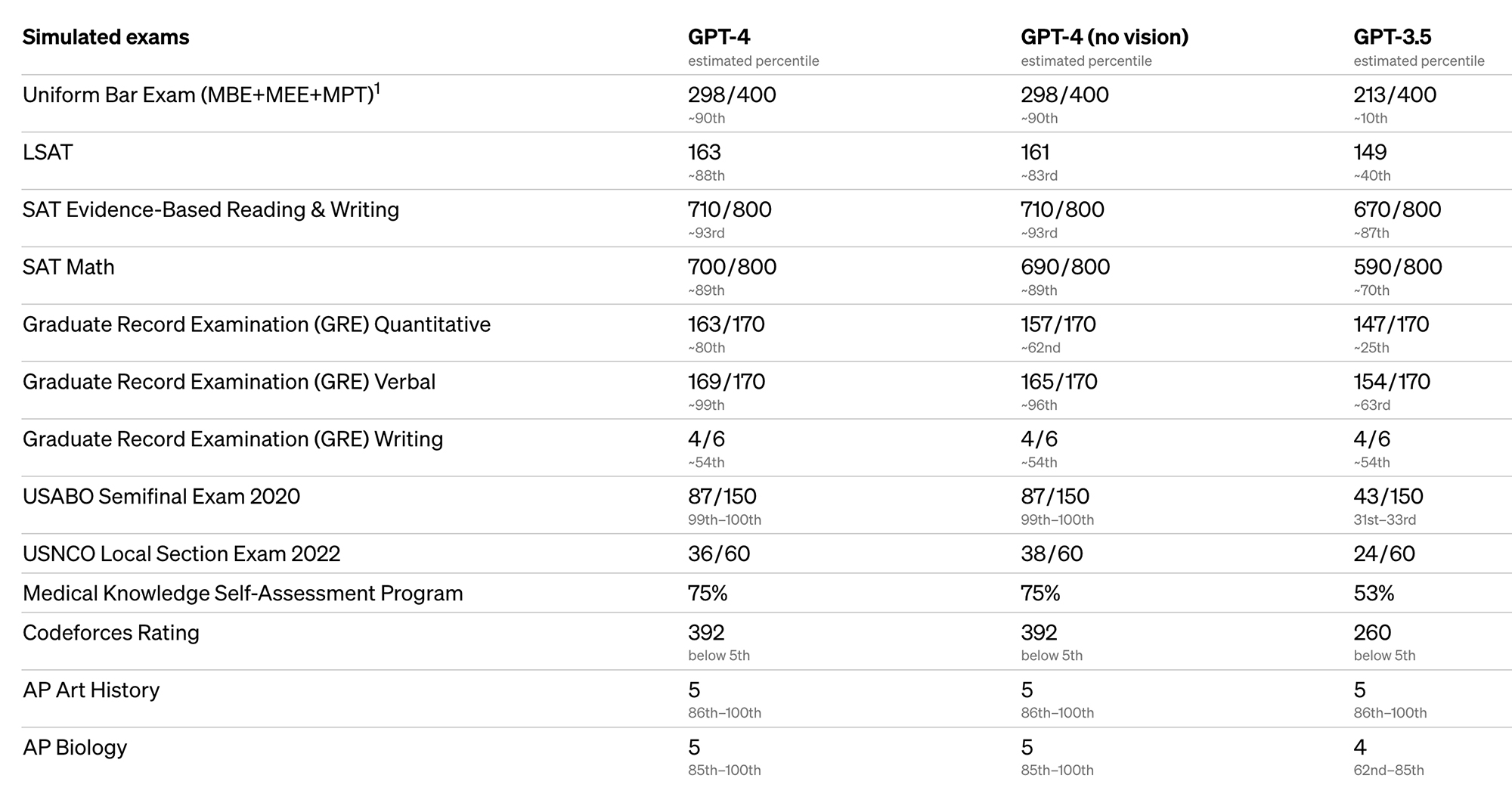

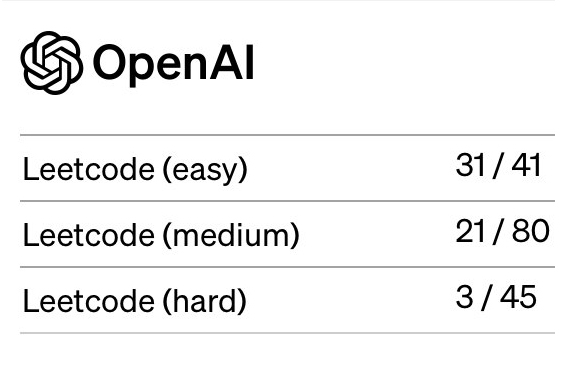

Сдает сложные экзамены на уровне отличников. Это как раз результат того, что GPT-4 лучше справляется с нетривиальными задачами. Например, языковая модель могла бы поступить в Стэнфордский университет или победить на олимпиаде по биологии. За американский адвокатский экзамен Bar нейросеть получила оценку, сравнимую с результатами 10% лучших участников-людей.

Гораздо лучше работает с русским языком. Разработчики OpenAI отмечают, что ChatGPT хорошо работала преимущественно на английском языке. С ним она показывала результат 70,1% точности в бенчмарке MMLU — специальном тесте для языковых моделей, который состоит из 14 тысяч задач по 57 предметам.

Чтобы проверить GPT-4, разработчики перевели бенчмарк на 26 языков. В 24 случаях четвертое поколение модели показало результат выше, чем результат предшественника на «родном» английском. Согласно отчету OpenAI, результат для русского языка — 82,7%, это восьмое место в общем рейтинге. Лучший результат у GPT-4 на английском — 85,5%.

Все ли проблемы ChatGPT решили в GPT-4

Нет, не все. Сооснователь OpenAI Сэм Альтман признается: модель все еще «несовершенна и лимитирована». GPT-4 кажется гораздо более впечатляющей при первом использовании, чем после активной работы с ней. Вот две главные проблемы, которые пока не решили.

Нейросеть все еще галлюцинирует. Галлюцинациями называют ошибки языковых моделей, когда те уверенно пишут полную неправду и выдают ее за факт. Поэтому в OpenAI советуют проводить дополнительную проверку всех ответов.

В то же время разработчики заявляют, что GPT-4 на 40% лучше предыдущей версии по внутренней шкале «оценки фактов». Наибольшего прогресса нейросеть достигла в темах истории и точных наук. Больше всего ошибок проявляется при просьбе сгенерировать код и в целом при работе с кодом.

Нейросеть все еще не оперирует актуальными данными. Набор данных, на которых обучали ChatGPT, был ограничен осенью 2021 года. То есть о любых новостях и фактах, которые появлялись после этого, GPT-3,5 не знала. И не могла учитывать новую информацию при ответах. В GPT-4 ситуация не изменилась.

Где попробовать GPT-4

Вместе с презентацией технологии в ChatAI объявили, что GPT-4 появится или уже появился в ряде сервисов. Разработчики отметили, что модель используют даже власти Исландии для сохранения своего языка.

Вот где заявлена поддержка GPT-4.

ChatGPT — бесплатная версия продолжит работать на GPT-3,5, а GPT-4 появился в платной подписке Plus. Пока использовать нейросеть можно с ограничениями — не более 100 запросов в течение четырех часов.

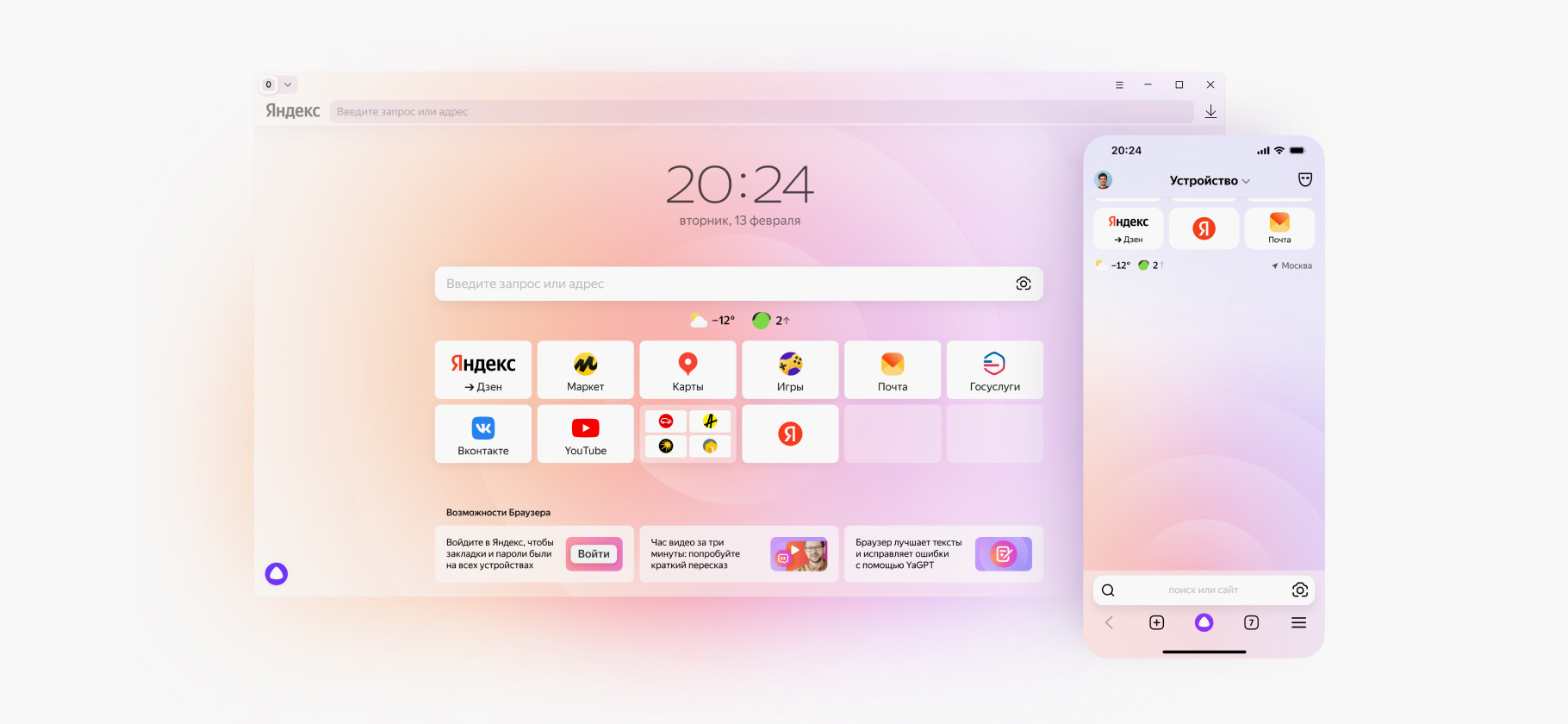

Bing — OpenAI и Microsoft тесно сотрудничают, последняя даже сделала для развития GPT суперкомпьютер. В поисковике Bing технологии OpenAI появились совсем недавно, и теперь компания подтвердила, что сервис работает на GPT-4. Bing — пока единственный способ попробовать нейросеть, которая располагает актуальными данными о мире.

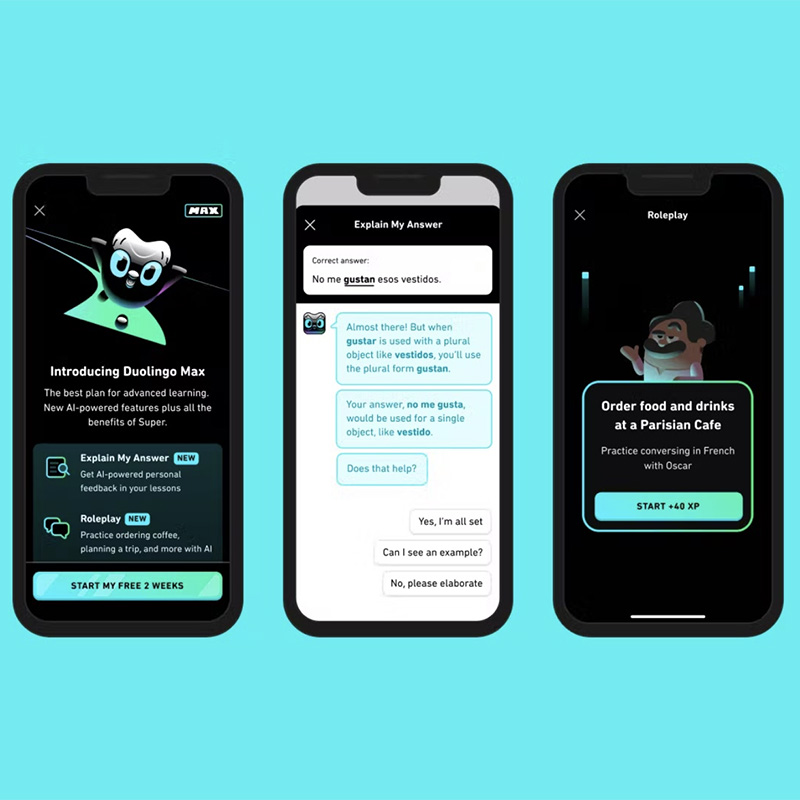

Duolingo — у популярного приложения для изучения языков появилась специальная подписка Duolingo Max. Она добавляет две функции: Explain my Answer помогает разобрать ошибки с чат-ботом, а в режиме Role Play можно общаться с ИИ-собеседником. Работает пока только с испанским и французским языками.

Poe — это приложение от создателей популярного англоязычного ресурса с вопросами и ответами Quora. В приложении можно общаться и задавать вопросы чат-ботам, в том числе ChatGPT. GPT-4 появился в платной подписке сервиса.

Мы будем обновлять список по мере новых анонсов. Также можно записаться в лист ожидания для доступа к API GPT-4 — инструментам для разработчиков.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult.