OpenAI представила «самую большую» модель GPT-4.5. Она естественнее общается и реже ошибается

27 февраля OpenAI показала превью новой модели GPT-4.5.

Это самая продвинутая и большая модель OpenAI. Пока она доступна только в режиме «исследовательского превью» подписчикам ChatGPT Pro за 200 $ (17 539 ₽) в месяц. В начале марта OpenAI планирует открыть доступ пользователям подписок Plus и Team. Расскажу, что известно о модели.

Имеет эмоциональный интеллект. GPT-4.5 способна вести беседы, которые кажутся более естественными и интуитивными. Она лучше улавливает смысл сказанного, замечает тонкие намеки и скрытые ожидания, считывает тон. Другими словами, демонстрирует развитый эмоциональный интеллект. Кроме того, GPT-4.5 лучше чувствует стиль и эстетику — это помогает с написанием текстов и дизайном.

Лучше понимает запросы. Для GPT-4.5 OpenAI разработали новые методы обучения, которые позволяют тренировать мощные модели, используя данные, полученные от предыдущих более простых версий. Это помогло улучшить способность следовать инструкциям от пользователя и распознавать контекст.

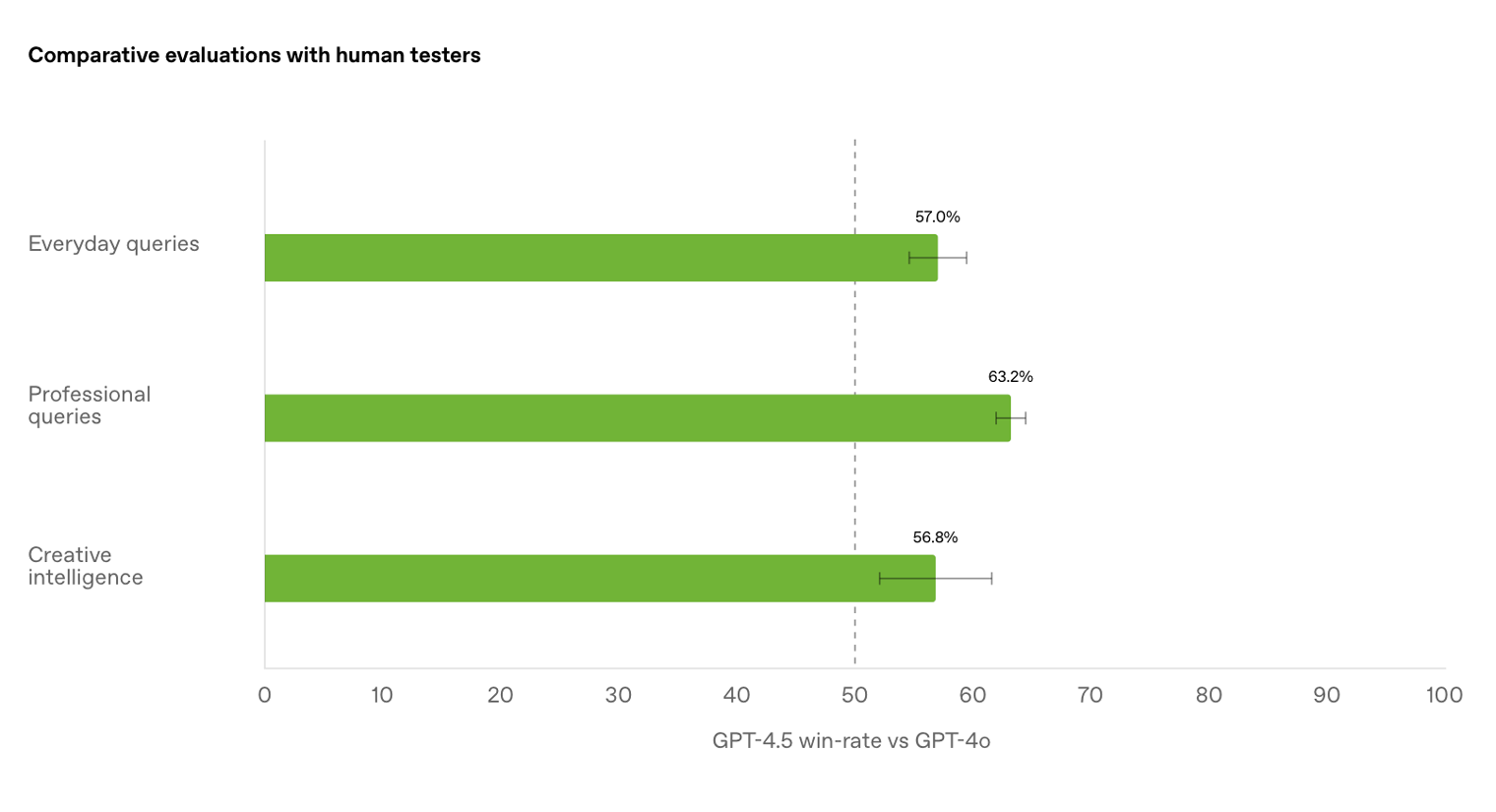

Полезна при решении креативных, профессиональных и повседневных задач. По сравнению с предыдущими версиями модель лучше улавливает закономерности, связывает идеи и предлагает креативные решения, хотя и без глубокого анализа.

Тестировщики посчитали, что в среднем в креативных, профессиональных и повседневных задачах GPT-4.5 дает лучшие ответы, чем предыдущая базовая версия нейросети GPT-4o.

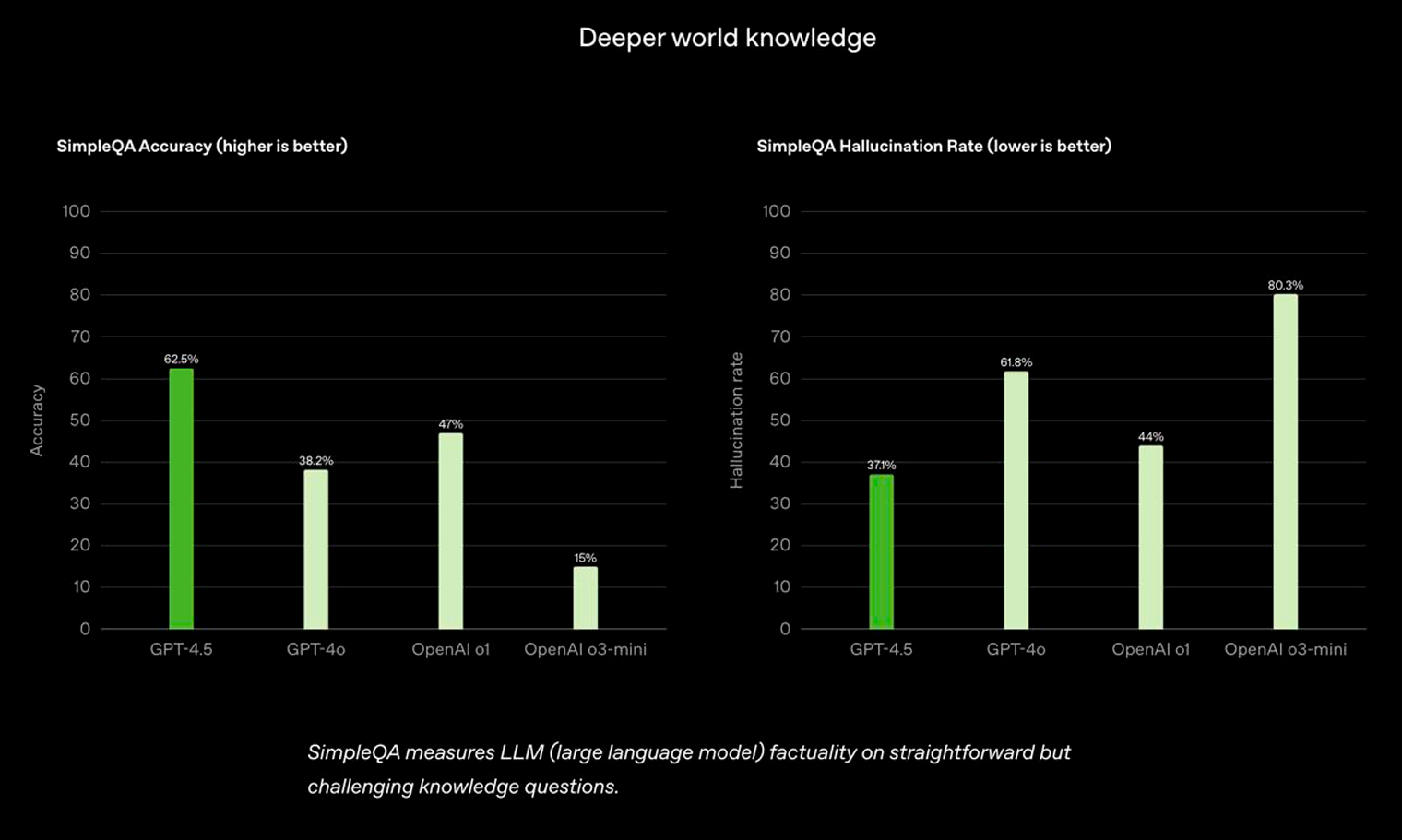

Не «рассуждающая» модель. GPT-4.5 не берет время на генерацию ответа и не строит цепочку рассуждений, как o1 или o3-mini. Хотя такие модели сильны в решении сложных задач, при разработке GPT-4.5 исследователи из OpenAI фокусировались на общем кругозоре модели и улучшении ее «интуиции». Благодаря этому она лучше понимает мир и работает стабильнее.

Меньше галлюцинирует. Точность ответов модели существенно выросла. GPT-4.5 выдает 62,5% правильных ответов, а GPT-4o — только 38,2%. Галлюцинации более редки, чем даже у «рассуждающей» модели o1.

В академических тестах обходит GPT‑4o, но уступает o3-mini. Новая модель лучше GPT-4o в науке, математике, языках, мультимодальности и программировании. Но при этом не дотягивает до «рассуждающей» o3-mini в математических и логических задачах.

Возможности пока ограничены. GPT-4.5 может искать актуальную информацию в интернете, распознавать файлы и картинки, а также работать с текстами и кодом в режиме Canvas. Однако пока модель не поддерживает голосовой режим, распознавание видео и демонстрацию экрана.

Доступна разработчикам по API. GPT-4.5 стоит 75 $ (6 577 ₽) за миллион токенов на входе и 150 $ (13 154 ₽) за миллион на выходе. Это существенно дороже, чем GPT-4o, которая в 30 и 15 раз дешевле соответственно. А китайская модель DeepSeek еще доступнее.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult