Сбер представил GigaChat 2.0 — новое поколение нейросети

13 марта Сбер представил новую версию нейросети GigaChat.

В компании называют GigaChat 2.0 сильнейшей нейросетью на русском языке. Пока она доступна только бизнес-клиентам. Расскажу, что изменилось.

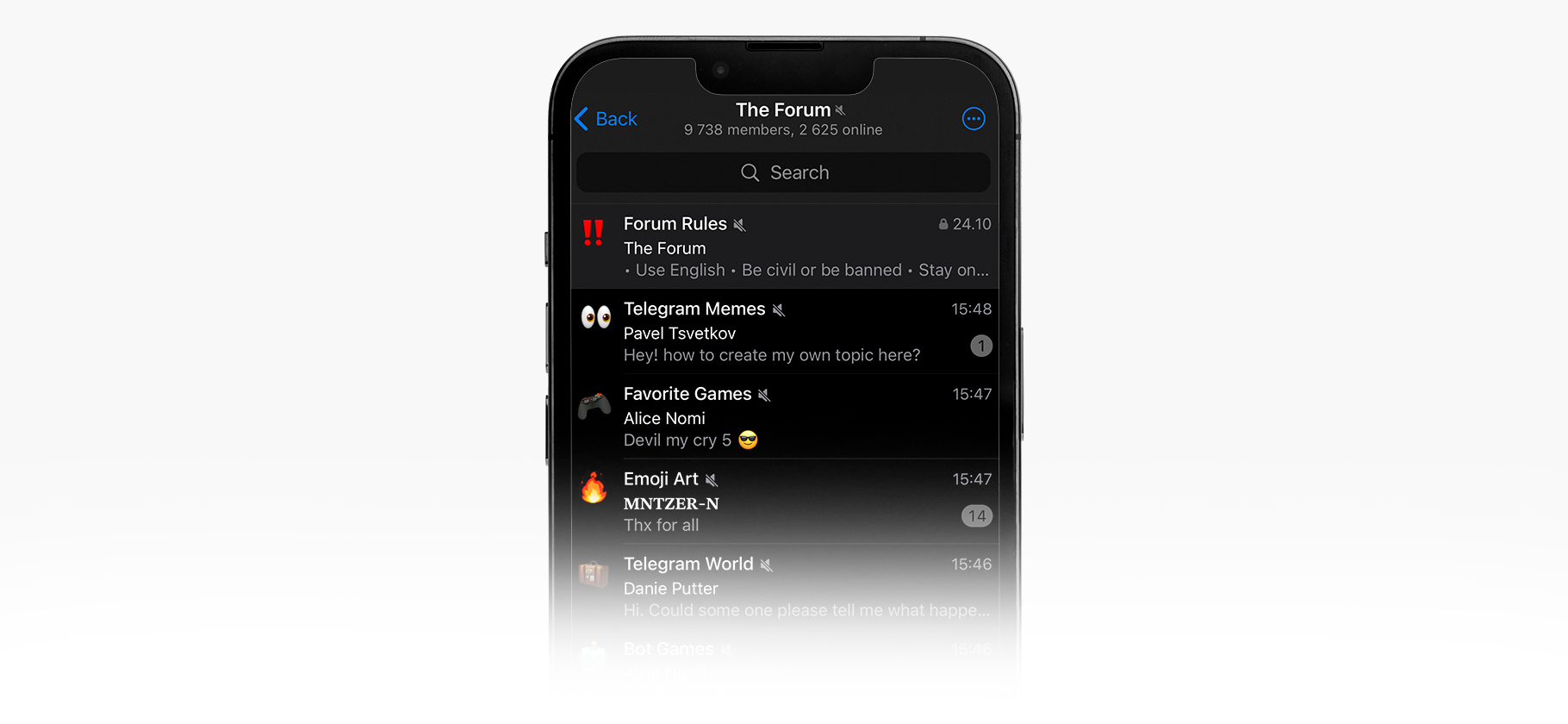

Все модели GigaChat получили апгрейд производительности. Как заявляют в Сбере, модели нового поколения обрабатывают в четыре раза больше контекста: максимальный объем запроса вырос с 48 до 200 страниц А4. Всего новых моделей три:

- GigaChat 2.0 MAX — самая мощная в линейке.

- GigaChat 2.0 Pro — для задач, в которых важны креатив и точность.

- GigaChat 2.0 Lite — для решения простых задач.

GigaChat 2.0 в два раза лучше решает рабочие задачи. Модели точнее следуют инструкциям и на 25% лучше отвечают на вопросы, соблюдают условия и отвечают в заданном формате. Производительность GigaChat 2.0 Pro теперь на уровне MAX предыдущего поколения, а GigaChat 2.0 Lite — на уровне прошлой Pro-версии.

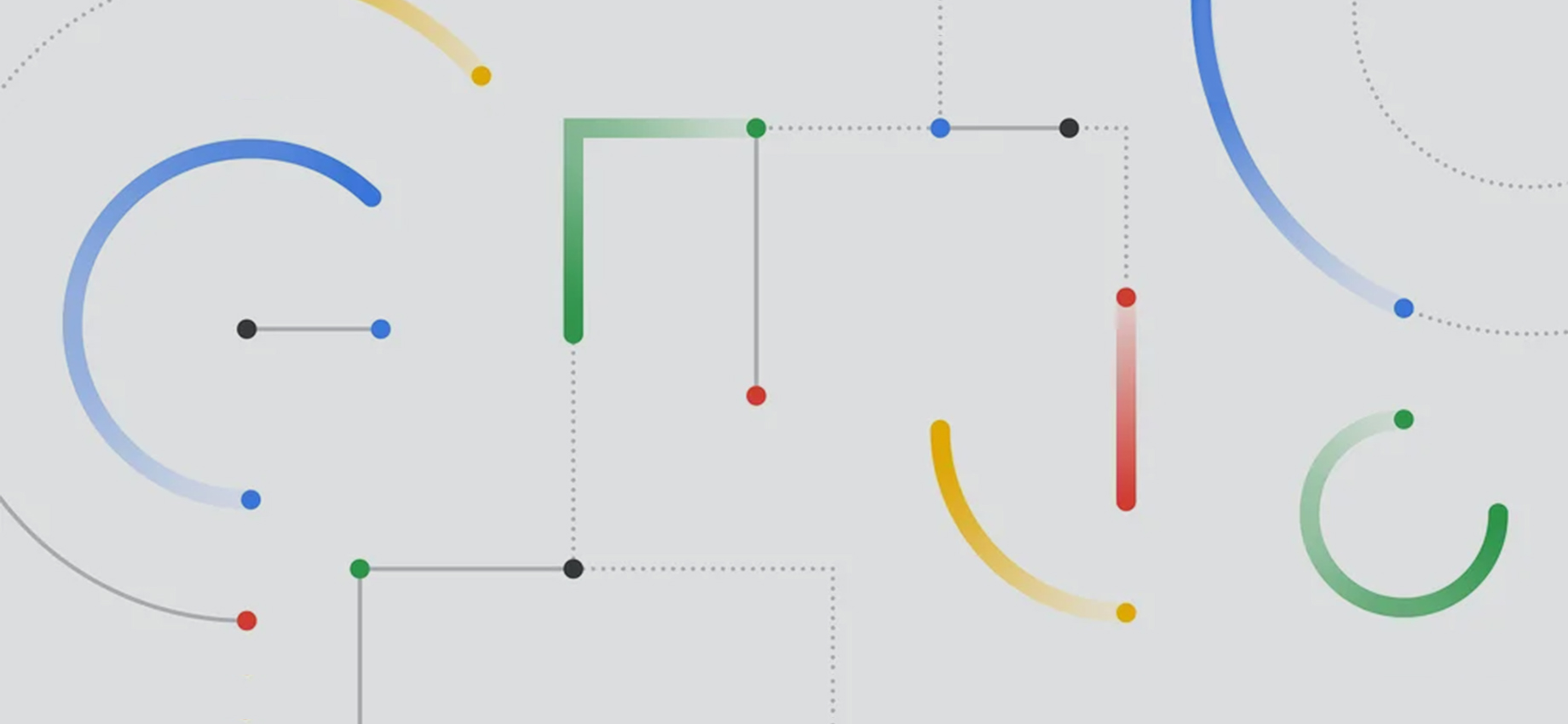

Сравнение GigaChat 2.0 MAX с другими ИИ-моделями в ряде бенчмарков

| Категория | Название бенчмарка | GigaChat 2 MAX | Qwen 2.5 72B | Llama 3.3 70B | GPT-4o | DeepSeek-V3 |

|---|---|---|---|---|---|---|

| Общие знания | MMLU (RU) | 80,46 | 78,30 | 65,08 | 80,00 | 73,74 |

| MMLU (EN) | 86,00 | 83,85 | 78,57 | 88,70 | 85,24 | |

| Математика | GSM8K | 95,68 | 95,07 | 92,87 | 95,00 | 94,99 |

| MATH | 77,26 | 78,74 | 62,80 | 76,60 | 85,48 | |

| Работа с кодом | HumanEval | 87,20 | 86,60 | 86,00 | 84,00 | 91,46 |

| Следование инструкциям | IFEVAL (RU) | 83,62 | 84,27 | 75,12 | 80,24 | 84,37 |

| IFEVAL (EN) | 89,99 | 90,43 | 90,83 | 88,51 | 92,21 |

На русском языке GigaChat 2.0 MAX опережает GPT-4o и DeepSeek-V3. Среди ИИ-моделей новая MAX-версия занимает первое место в бенчмарке MERA для оценки больших языковых моделей для русского языка, а GigaChat 2.0 Pro — второе. При работе на английском языке нейросеть «не уступает мировым лидерам», утверждают в Сбере.

На базе GigaChat 2.0 можно создавать ИИ-агентов, которые способны рассуждать и решать сложные задачи без участия человека. Для этого моделям расширили знания в математике, естественных и гуманитарных науках, программировании.

Линейка GigaChat 2.0 пока доступна только для бизнеса. Ее можно протестировать в облаке через API или развернуть в локальной инфраструктуре компании. Когда модели станут доступны обычным пользователям, неизвестно.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult